Human-in-the-Loopの活用事例 Difyでの具体的な運用パターン9選

1. はじめに

最近のDifyや生成AI界隈において、大きなトレンドとなっているのが「Agentic Workflow(エージェンティック・ワークフロー)」です。これは、AIが単なる「質問応答ツール」から「自律的に思考し、ツールを使いこなし、タスクを完遂するエージェント」へと進化する流れを指しています。

しかし、AIの自律性が高まれば高まるほど、ある深刻な課題が浮上します。それは、「AIが間違った方向に暴走した場合、誰がどうやって止めるのか?」という問題です。

もしHITLのような安全装置を設けず、AIを完全自動で本番運用し続けた場合、企業は致命的なリスクに直面します。

- 自社情報・機密情報の漏洩:AIが社内システムにアクセスし、本来出してはいけない機密データを顧客に送信してしまう。

- 顧客への誤案内による炎上:カスタマーサポートAIが勝手な値引き対応や虚偽の案内を行い、SNSで炎上しブランドが失墜する。

- 法務・コンプライアンス違反:AIが作成した契約書や規約のミスを誰もチェックせずに締結し、取り返しのつかない訴訟問題に発展する。

AIが自律的に動けるということは、「人間が気づかないうちに、AI単独で大事故を起こせる」ということと同義です。AIに強力な「アクセル(自律性)」が備わったからこそ、大事故を未然に防ぐための確実な「ブレーキ(人間の介在)」が絶対不可欠になります。

そこで「AIの暴走を防ぐためのブレーキ」として現在最も注目されているのが、Human In The Loop(HITL:ヒューマン・イン・ザ・ループ)というアプローチです。今回の記事では、いきなり高度な自律型エージェントに挑む前に、まずは社内の日常業務(FAQや議事録など)にこのHITLという安全装置を組み込むための「基本的な使い方と実装パターン」をご紹介します。本記事では、HITLの基本概念から、Difyを使った具体的な実装方法、そして幅広い業界での活用事例までを網羅的に解説します。

🚀 本記事のサマリー(結論)

- HITLとは:AIの処理フローの中に「人間の判断・確認・承認」を組み込むことで、AIの精度と信頼性を飛躍的に高めるアプローチ。

- Difyでの実装:Difyの「人間の入力」ノードを活用すれば、承認・修正・差し戻しといったHITLフローをノーコードで構築可能。

この記事で分かること

- Difyを使ったHITLチャットフロー/ワークフローの具体的な構築手順(2事例)

- 業界別のHITL活用事例7選

- HITL導入のメリットとデメリット

2. Human In The Loop(HITL)とは?

Human In The Loop(HITL)とは、 AIが自動で処理を行うフローの中に、意図的に「人間による確認・判断・修正」のステップを挟み込む設計思想のことです。

AIは大量のデータ処理やパターン認識といった「量とスピード」の面で圧倒的な強みを持っています。一方で、曖昧な状況の判断、倫理的な配慮、そして過去の経験に基づいたニュアンスの理解という点では、まだ人間に遠く及びません。

HITLは、この「AIが得意なこと」と「人間にしかできないこと」を最適に組み合わせるための仕組みです。

| AIが得意なこと | 人間が得意なこと | |

|---|---|---|

| 処理速度 | 1秒で数千件を処理できる | 1件ずつ丁寧に確認する |

| 一貫性 | 疲れずに同じ基準で判断し続ける | 状況に応じて柔軟に基準を変えられる |

| 判断力 | 明確なルールに基づくパターン認識 | 曖昧さ・文脈・感情の読み取り |

| 責任 | 判断の説明責任を負えない | 最終的な意思決定と責任を担える |

つまり、HITLとは「AIに任せきりにしない。しかし、人間がすべてを手作業でやるのでもない。両者の強みを掛け合わせる」という、AI活用における最もバランスの取れたアプローチなのです。

3. HITLの3つの主要パターン

HITLの実装方法は、大きく分けて以下の3つのパターンに分類できます。

パターン①:承認型(Approval)

AIが出力した結果を、人間が「承認(OK)」または「却下(NG)」するパターンです。承認されれば次の処理へ進み、却下されればAIに再生成を指示するか、処理を停止します。

適用例: 営業メールの送信前承認、社内FAQの回答公開前チェック、見積書の自動作成後の上長承認

パターン②:修正型(Correction)

AIが出力した結果を、人間が直接編集・修正してから次の処理に進めるパターンです。AIの出力を「たたき台(ドラフト)」として活用し、人間が仕上げるイメージです。

適用例: AI生成レポートの編集、翻訳結果のポストエディット、議事録の修正・補足

パターン③:エスカレーション型(Escalation)

AIが自分の判断に「自信がない」場合や、事前に定義された特定の条件に該当する場合にのみ、処理を人間に引き継ぐパターンです。すべてを人間が確認するのではなく、例外処理的なアプローチをとることで、スケーラビリティと安全性を両立させます。

適用例: チャットボットで対応困難な質問を人間オペレーターへ転送、AIの信頼度スコアが閾値を下回った場合の人手レビュー

【Difyでの実装イメージ】

エスカレーション型は「直列に人間の入力ノードを置く」上記の2つとは異なり、「条件分岐(IF/ELSE)ノード」と組み合わせて構築します。

たとえば、LLMノードに「回答の自信度(1〜100)」を算出させ、その数値を変数(例:confidence_score)として出力させます。次の条件分岐ノードで「confidence_score が80未満の場合は『人間の入力』ノードへ進む」「80以上の場合はそのまま出力する」といったルーティングを組むことで、Dify上でエスカレーション型を実現できます。

4. 【実践①】社内FAQ+人間承認チャットフロー(ステップバイステップ)

ここでは、Difyの「チャットフロー」と「人間の入力」ノードを使って、社内ナレッジベースを元にAIが回答を生成し、管理者が承認してからユーザーに回答を返すHITLフローを構築します。

【このフローを導入するメリット(Benefit)】

社内規程や就業規則に関する質問は、1つの誤答が従業員の不利益や労務トラブルに直結します。この「承認型HITL」を導入することで、以下の劇的な変化が得られます。

- Before(従来の人力対応):

総務担当者が1件ずつマニュアルを検索して回答。対応に平均1日〜数日かかり、担当者の業務を圧迫。 - After(完全自動AIのリスク):

即時回答できるが、もしAIが「忌引休暇は5日(正しくは3日)」などとハルシネーションを起こした場合、労務トラブルに発展する危険性がある。 - ✨ After + HITL(本フローの導入後):

AIが数秒でドラフトを作成し、総務担当者は「内容を読んで承認ボタンを押すだけ」に。回答スピードが数分〜数時間に短縮されつつ、回答の正確性は100%保証される。担当者の作業負荷も約80%削減されます。

チャットフロー全体像

[ユーザー入力]

│

▼

[知識検索] ──> [LLM:回答ドラフト作成]

│

▼

[人間の入力ノード](管理者が回答を確認)

│

┌───────┴───────┐

▼ ▼

[承認された場合] [却下された場合]

回答をそのまま 「回答を準備中です。

ユーザーに出力 しばらくお待ちください」

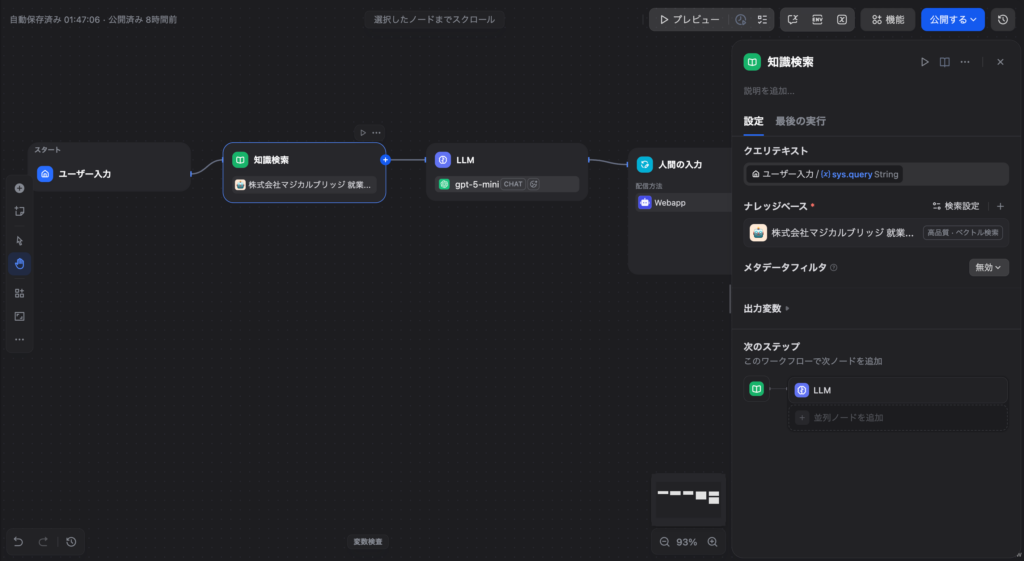

と返して処理終了Step 1:知識検索ノード

ユーザーからの質問(sys_query)を使って、社内ナレッジベース(就業規則や社内規程など)を検索し、関連する情報を取得します。

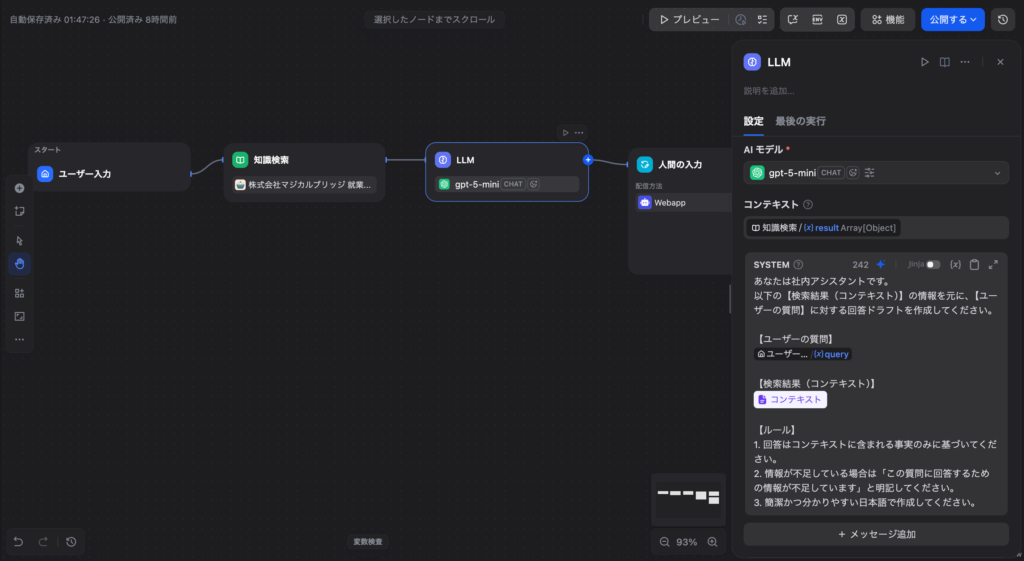

Step 2:LLMノード(回答ドラフトの作成)

検索結果(コンテキスト)を元に、AIが回答のドラフトを作成します。

【回答ドラフト作成プロンプトの例(LLMノード)】

あなたは社内アシスタントです。

以下の【検索結果(コンテキスト)】の情報を元に、【ユーザーの質問】に対する回答ドラフトを作成してください。

【ユーザーの質問】

{{ sys_query }}

【検索結果(コンテキスト)】

{{ context }}

【ルール】

1. 回答はコンテキストに含まれる事実のみに基づいてください。

2. 情報が不足している場合は「この質問に回答するための情報が不足しています」と明記してください。

3. 簡潔かつ分かりやすい日本語で作成してください。Step 3:人間の入力ノード(管理者による承認)

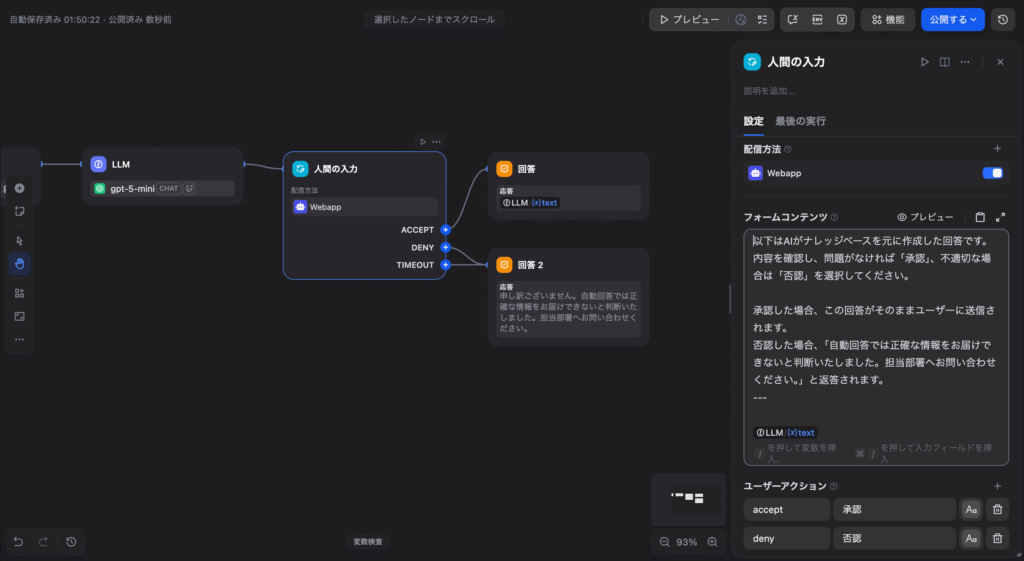

ここがHITLの核心です。Difyの「人間の入力」ノードを配置します。

このノードが実行されると、フローは一時停止し、管理者にWebアプリ上で通知が届きます。管理者はAIが作成した回答ドラフトを確認し、ノードに組み込まれた以下の3つの分岐のいずれかを選択します:

- ACCEPT(承認):回答内容に問題なし → 「回答」ノードへ接続し、LLMの出力をそのままユーザーに出力

- DENY(否認):回答が不適切 → 「回答 2」ノードへ接続し、定型メッセージを出力

- TIMEOUT(タイムアウト):管理者が一定時間内に応答しなかった場合 → 「回答 2」ノードへ接続(否認と同じ扱い)

【フォームコンテンツの記述例】

## 📋 AIが作成した回答ドラフト

以下はAIがナレッジベースを元に作成した回答です。

内容を確認し、問題がなければ「承認」、不適切な場合は「否認」を選択してください。

承認した場合、この回答がそのままユーザーに送信されます。

否認した場合、「自動回答では正確な情報をお届けできないと判断いたしました。担当部署へお問い合わせください。」と返答されます。

---

{{ LLM.text }}💡 ポイント

Difyの「人間の入力」ノードは、別途IF/ELSEノードを配置しなくても、ノード自体に ACCEPT / DENY / TIMEOUT の3つの出力ポートが用意されています。それぞれのポートから直接「回答」ノードへ線を繋ぐだけで分岐が完成するため、フローの構成が非常にシンプルになります。

Step 4:回答ノードの設定

人間の入力ノードの各分岐先に、それぞれ「回答」ノードを配置します。

- 「回答」ノード(ACCEPT時): LLMノードの出力テキスト(

LLM {x} text)をそのままユーザーに返します。 - 「回答 2」ノード(DENY / TIMEOUT時): 「申し訳ございません。自動回答では正確な情報をお届けできないと判断いたしました。担当部署へお問い合わせください。」という定型メッセージを返して処理終了します。

このフローのポイント

💡 なぜこのフローが有効なのか?

社内規程や就業規則に関する質問は、誤った回答が従業員の不利益や法的トラブルに直結するリスクがあります。AIが高速にドラフトを作成し、人間の管理者が最終チェックするこのフローにより、回答スピードと正確性の両立が実現できます。

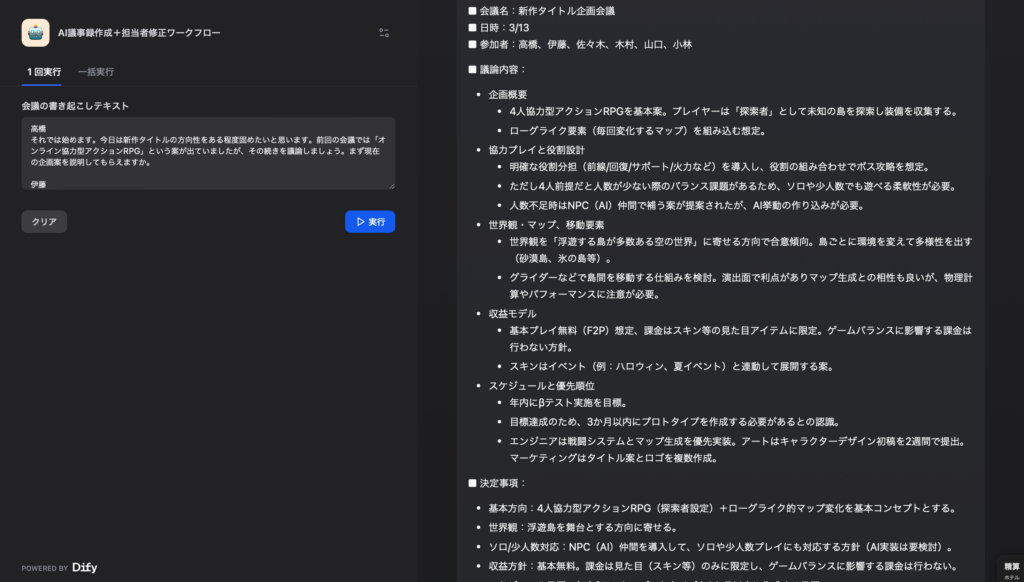

5. 【実践②】AI議事録作成+担当者修正ワークフロー(ステップバイステップ)── 修正型(Correction)

次に、Difyの「ワークフロー」機能を使って、AIが会議の書き起こしテキストから議事録ドラフトを自動作成し、担当者が直接内容を編集・修正してから最終版として出力するHITLフローを構築します。これは、パターン②の「修正型(Correction)」にあたります。

【このフローを導入するメリット(Benefit)】

議事録作成は「正確さ」と「空気(文脈)」の両方が求められ、完全自動化が難しい業務の筆頭です。この「修正型HITL」を導入することで、以下の劇的な変化が得られます。

- Before(従来の人力対応):

担当者が録音を聞き返しながら1時間〜数時間かけて文字起こしと要約を実施。会議のたびに膨大な作業工数が発生。 - After(完全自動AIのリスク):

AIに任せれば数秒で終わるが、「冗談で出たアイデアが決定事項になっている」「Aさんの発言がBさんのものになっている」などの文脈エラーを見落としたまま社内共有され、後日大きな手戻りや認識決定のミスに繋がるリスクがある。 - ✨ After + HITL(本フローの導入後):

AIが「80点のドラフト」を数秒で作成し、担当者は「残りの20点の文脈修正と手直し」を行うだけに。ゼロから書く場合と比べて作業時間は約90%削減(1時間→5分など)されつつ、人間にしか分からない文脈を反映した「完璧な議事録」を安全に共有できるようになります。

ワークフロー全体像

[開始(入力:会議の書き起こしテキスト)]

│

▼

[LLM:議事録ドラフトの自動作成]

│

▼

[人間の入力ノード](担当者がドラフトを直接編集・修正)

│

▼

[修正後の議事録を最終出力として返す]💡 承認型との違い

実践①の承認型では「OK or NG」の二択でしたが、修正型では人間がAI出力のテキストを自由に書き換えてから次へ進めます。AIの出力を「たたき台(ドラフト)」として活用し、人間が仕上げるイメージです。

Step 1:開始ノード(入力パラメータの設定)

ワークフローの開始ノードで、以下の入力フィールドを定義します:

transcript:会議の書き起こしテキスト(音声認識ツール等で取得したもの)

Step 2:LLMノード(議事録ドラフトの作成)

書き起こしテキストを元に、AIが構造化された議事録ドラフトを作成します。

【議事録作成プロンプトの例(LLMノード)】

あなたはプロの議事録作成担当者です。

以下の会議書き起こしテキストを元に、構造化された議事録を作成してください。

【会議の書き起こしテキスト】

{{ transcript }}

【出力フォーマット】

■ 会議名:(推定して記載)

■ 日時:(推定して記載)

■ 参加者:(推定して記載)

■ 議論内容:

- 議題ごとに要点を箇条書きで整理

■ 決定事項:

- 決定した内容を明確に記載

■ アクションアイテム:

- 担当者・期限を明記

【ルール】

1. 書き起こしの発言を要約し、冗長な表現は省いてください。

2. 推定が難しい項目には「(要確認)」と記載してください。

3. 決定事項とアクションアイテムは特に正確に記載してください。Step 3:人間の入力ノード(担当者による修正)

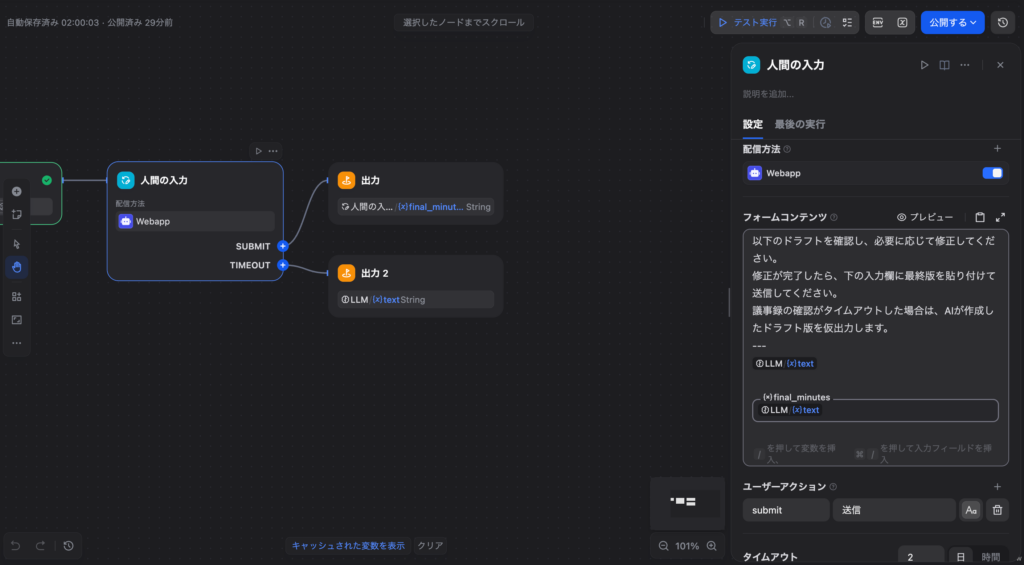

ここが修正型HITLの核心です。Difyの「人間の入力」ノードを配置し、以下の項目を設定します。

3-1. 配信方法

Webapp を選択します。DifyのWebアプリ画面上に直接フォームが表示され、担当者がその場で議事録を確認・修正できるようになります。

3-2. フォームコンテンツ

担当者に提示する内容をMarkdownで記述します。ここにLLMノードの出力変数を埋め込むことで、AIが作成したドラフトが自動的に表示されます。

【フォームコンテンツの記述例】

## 📝 AIが作成した議事録ドラフト

以下のドラフトを確認し、必要に応じて修正してください。

修正が完了したら、下の入力欄に最終版を貼り付けて送信してください。

議事録の確認がタイムアウトした場合は、AIが作成したドラフト版を仮出力します。

---

{{ LLM.text }}💡 変数の挿入方法

{{ LLM.text }}は手入力ではなく、フォームコンテンツ欄の右上にある{x}ボタン(変数挿入)をクリックし、LLMノードの出力変数を選択すると自動で挿入されます。

3-3. 入力フィールドの追加

フォームコンテンツの中に「入力フィールド」を挿入し、担当者が修正後のテキストを入力できるようにします。

| 設定項目 | 設定値 |

|---|---|

| レスポンスを次の名前で保存 | final_minutes |

| フィールドを事前入力 | {x} 変数 → LLMノードの出力(LLM.text)を選択 |

💡 事前入力のポイント

「フィールドを事前入力」にLLMの出力を設定しておくと、担当者がフォームを開いた瞬間にAIのドラフトが入力欄に最初から入った状態で表示されます。担当者はゼロから書き直す必要がなく、ドラフトの一部を直接編集するだけで済むため、作業効率が大幅に向上します。

3-4. ユーザーアクション

担当者が修正を完了した際に押すボタンを設定します。修正型では1つだけでOKです。

| アクションID | ボタンテキスト |

|---|---|

submit | 📝 送信 |

3-5. タイムアウト

担当者が一定時間内に応答しなかった場合の制限時間を設定します(例:3日)。タイムアウトした場合は、TIMEOUTポートに接続した出力ノードへ処理が流れます。

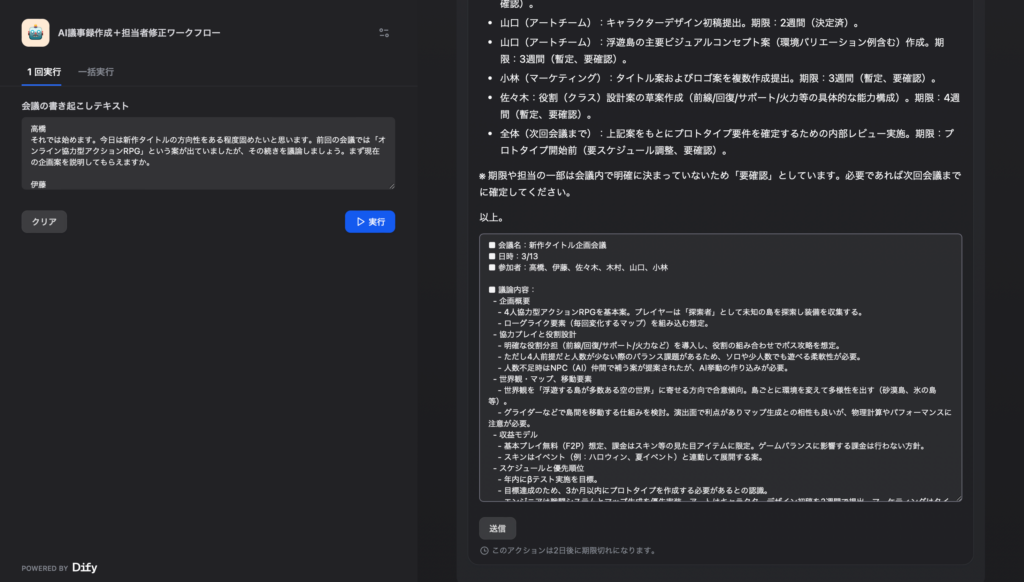

このノードが実行されると、フローは一時停止し、担当者のWebアプリ画面にフォームが表示されます。担当者は以下のような修正を直接行います:

- 📝 「(要確認)」と記載された項目の正確な情報への差し替え

- ✏️ AIが要約しすぎた箇所の補足・加筆

- 🔧 参加者名やプロジェクト名の誤りの修正

- ➕ AIが拾えなかったニュアンスや背景情報の追記

担当者が編集を完了し「📝 修正完了・送信」ボタンを押すと、final_minutes に入力された修正後のテキストが次のノードへ渡されます。

Step 4:最終出力

人間の入力ノードの各分岐先に、それぞれ出力ノードを配置します。

- ACTION(修正完了・送信)ポート: 担当者が修正した議事録テキスト(

final_minutes)を最終版としてそのまま出力します。このテキストをSlackやメール、社内Wikiなどへ自動連携することも可能です。 - TIMEOUT ポート: 担当者が制限時間内に応答しなかった場合、LLMノードの出力(

LLM.text)をそのまま仮出力して処理を終了します。フォームコンテンツに記載した通り、タイムアウト時はAIのドラフト版がそのまま出力される旨を担当者にあらかじめ伝えておくことで、確認を促す効果もあります。

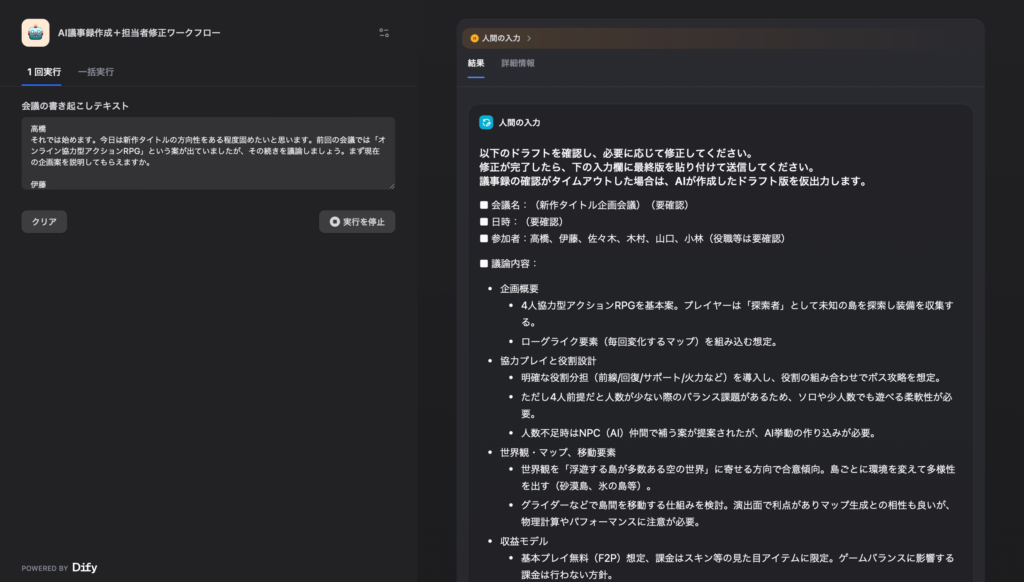

【実際のテスト結果(出力例の抜粋)】

以下は、あるゲーム開発会社の企画会議の書き起こしテキストを入力した際の、AIによる議事録ドラフトの出力例です。このように、会議の生の書き起こしから構造化された議事録が数秒で自動生成されます。

■ 会議名: 新作タイトル企画会議(オンライン協力型アクションRPG方向性検討)

■ 参加者: 高橋(プロジェクト責任者)、伊藤(企画)、佐々木(ゲームデザイン)、木村(エンジニア)、山口(アート)、小林(マーケティング)■ 決定事項:

- 4人協力型アクションRPGを基軸とし、世界観を「浮遊島の冒険」寄せで進行

- ローグライク要素(毎回変化するマップ)を採用

- 基本無料+見た目(スキン)販売に限定、ゲームバランスに影響する課金は行わない

■ アクションアイテム(一部抜粋):

- 伊藤(企画):プロトタイプ仕様の取りまとめ → 3週間以内

- 木村(エンジニア):戦闘システムのプロトタイプ実装 → 3か月以内

- 山口(アート):キャラクターデザイン初稿提出 → 2週間

推定が難しい箇所には「(要確認)」というタグが自動的に付与されるため、担当者が修正すべきポイントが一目で分かる設計になっています。

このフローのポイント

💡 なぜ修正型が議事録に最適なのか?

議事録は「正確さ」と「ニュアンス」の両方が求められるドキュメントです。AIはゼロから構造化されたドラフトを数秒で作成できますが、「この発言は冗談だったから省くべき」「この決定事項にはこういう背景があった」といった人間にしか分からない文脈があります。修正型HITLであれば、AIが作った80%の土台に人間が20%の仕上げを加えるだけで済み、ゼロから議事録を書く場合と比べて作業時間を大幅に短縮できます。

6. その他のHITL活用事例7選

上記の2つのステップバイステップ事例に加えて、HITLが真価を発揮する7つの業界・業務シーンを紹介します。

事例①:コンテンツモデレーション(SNS・プラットフォーム運営)

- 課題:SNSや口コミサイトにおいて、日々膨大な量の投稿やコメントの中から不適切なコンテンツ(誹謗中傷・暴力的表現・スパム等)を検知する必要があり、人手だけでは追いつきません。

- HITLの適用:AIが不適切と判定したコンテンツ、または判定スコアがグレーゾーンにあるコンテンツを、人間のモデレーターが最終レビューして削除・非表示の判断を下します。

- 効果:AI単独では誤検知(正当な投稿の削除)や見逃しが発生しやすいが、人間の判断を組み合わせることで精度と公平性を大幅に向上させられます。

事例②:医療画像診断の支援(ヘルスケア)

- 課題:X線やCTスキャンなどの医療画像から疾患を検出するには、高度な専門知識と膨大な読影時間が必要です。

- HITLの適用:AIが初期スクリーニングを行い、異常の疑いがある画像をハイライトして医師に提示します。最終的な診断は必ず医師が行います。

- 効果:医師の読影時間を大幅に短縮しつつ、AIの見落としを医師が、医師の見落としをAIが補完するダブルチェック体制が構築できます。

事例③:契約書・法務チェック(法務・管理部門)

- 課題:契約書のリスク条項の確認、個人情報の取り扱い、各種法令への適合チェックなど、法務レビューは時間とコストがかかる業務です。

- HITLの適用:AIが契約書をスキャンし、リスクの高い条項や不足している条項をハイライト・レポート化して法務担当者に提示します。法務担当者が最終的な修正・承認を行います。

- 効果:チェック漏れのリスクを減らしつつ、法務担当者はAI が既にピックアップしたポイントに集中できるため、レビュー速度が飛躍的に向上します。

事例④:製造ラインの品質検査(製造業)

- 課題:製品の外観検査(傷・汚れ・形状不良など)を目視で行うには、検査員の熟練度に依存し、見落とし率にばらつきがあります。

- HITLの適用:AIが画像認識で不良品候補を検出し、検査員にアラートを出します。検査員がAIの判定結果を最終確認し、合否を決定します。

- 効果:検査員の負荷を軽減しながら、AIの誤検知を人間がフィルタリングすることで品質基準の一貫性と検出率の両方を向上させます。

事例⑤:カスタマーサポートのエスカレーション(サービス業)

- 課題:チャットボットで1次対応を自動化しているものの、複雑な問い合わせや感情的なクレームに対してAIが適切に対応できないケースがあります。

- HITLの適用:AIが対応困難と判断した場合(例:「オペレーターと話したい」「解約したい」等のキーワード検知)、自動的に人間のオペレーターへエスカレーションします。

- 効果:単純な問い合わせはAIが即座に処理し、本当に人間の対応が必要なケースにのみオペレーターのリソースを集中させることで、対応品質と効率の両立が実現します。

事例⑥:経理・請求書のデータ抽出(バックオフィス)

- 課題:取引先ごとにフォーマットが異なる請求書や領収書から、金額・日付・品目などを正確にデータ化する作業は、膨大な時間を要します。

- HITLの適用:AIが OCR+自然言語処理で請求書のデータを自動抽出し、信頼度スコアが低い項目(手書き文字、かすれた印字など)のみを人間の経理担当者に確認させます。

- 効果:全件を人間がチェックする場合に比べて作業時間を60〜80%削減しつつ、AIだけでは確信が持てない項目は人間が正確に入力するため、データ品質も維持できます。

事例⑦:採用スクリーニング(人事・HR)

- 課題:大量の応募書類を短期間で選考する必要がある一方、AI単独でのスクリーニングは性別・学歴・年齢などに基づく無意識のバイアスを増幅するリスクがあります。

- HITLの適用:AIが応募書類を分析し、スキルマッチングや経験年数に基づくスコアリングを行います。ただし、最終的な選考判断は必ず人事担当者が行い、AIのスコアは「参考情報」として扱います。

- 効果:人事担当者の業務負荷を軽減しつつ、AIのバイアスを人間が監視・是正する仕組みを構築することで、公平で透明性のある採用プロセスを実現できます。

7. HITLのメリット・デメリット

HITLは万能ではありません。導入前にメリットとデメリットの両方を正しく理解しておくことが重要です。

メリット

- 精度と信頼性の向上:AIの出力を人間がチェックすることで、ハルシネーションや誤判断を未然に防止できます。

- ハルシネーションリスクの低減:AIが生成した嘘や不正確な情報を、人間のフィルタリングで100%ブロックできます。

- エッジケースへの対応:AIが想定外の入力や曖昧な状況に直面した際、人間が柔軟に対処できます。

- コンプライアンスの確保:法規制・業界ガイドラインへの準拠を人間が最終確認することで、説明責任を果たせます。

- AIの継続的な改善:人間のフィードバック(修正履歴や却下理由)をAIの学習データに還元し、モデルの精度を向上させるサイクルを構築できます。

デメリット

- スケーラビリティの制約:全ての処理に人間の確認を求めると、処理量が非常に膨大になります。対策として、リスクの高いケースに限定してHITLを適用する設計が重要です。

- コストと処理速度の増大:人件費が発生し、AIだけの自動処理に比べて完了まで時間がかかります。

- 人間側のバイアス混入:AIのバイアスを排除する一方で、確認する人間の主観や偏見が新たに入り込むリスクがあります。

- 担当者のスキル依存:HITLの品質は、介入する人間の専門知識や判断力に大きく依存します。担当者の教育と標準化が不可欠です。

⚠️ 注意:HITLの「形骸化」リスク

よくある失敗として、「とりあえず何でも目視確認」というルールにした結果、担当者が作業をこなすこと自体が目的化し、内容を見ずにすべて承認(OK)ボタンを連打するだけになってしまうケース(ラバースタンプ)があります。

HITLを正しく機能させるには、「AIが自信度スコア80点未満を出した時だけ人間に回す」といった、どこに人間を介入させるかの線引き(トリガー条件)の設計が、AIプロンプト以上に重要です。

どう使い分けるか?

| 判断基準 | 完全自動化(AI単独) | HITL(人間介入あり) |

|---|---|---|

| リスクの大きさ | 低い(社内チャットの雑談対応など) | 高い(法務・医療・金融など) |

| 処理量 | 大量(1日数万件など) | 中〜少量(重要案件に絞る) |

| 正確性の要求度 | ある程度の誤差が許容される | 誤りが一切許容されない |

| 責任の所在 | 明確でなくても問題ない | 最終判断の責任者が必要 |

8. まとめ

本記事では、AI活用における最も実践的で信頼性の高いアプローチである「Human In The Loop(HITL)」について、基本概念から具体的な実装方法、そして幅広い業界での活用事例までを解説しました。

AIの進化は加速しており、生成AIの出力品質は日を追うごとに向上しています。しかし、どれだけAIが進化しても、「ハルシネーションのリスクがゼロになる日」はまだ遠い未来の話です。だからこそ、人間が最終チェックを行う仕組みを意図的にフローに組み込んでおくことが、安全で信頼性の高いAI運用の鍵になります。

Difyの「人間の入力」ノードを活用すれば、こうしたHITLフローをノーコードで簡単に構築・テストでき、高度な開発スキルがなくても即座に業務に導入できます。

- HITLとは:AIの処理フローに人間の確認・承認・修正を組み込むことで、精度と信頼性を飛躍的に高めるアプローチ

- 3つのパターン:承認型(Approval)・修正型(Correction)・エスカレーション型(Escalation)

- Difyでの実装:「人間の入力」ノードを使えば、チャットフロー/ワークフローの中にHITLをノーコードで組み込める

- 従来の完全自動化で十分なケース:リスクが低く、大量処理が求められる業務(社内チャットの雑談対応、単純なFAQ等)

- HITLが必要なケース:法務・医療・金融・顧客対応など、誤りが許されず最終判断の責任者を明確にする必要がある業務

「AIに任せきりにしない。しかし、人間もすべてを手作業でやらない」。この人間とAIの理想的な協調関係を設計することこそが、これからのAI導入成功の最大の鍵です。

最後に

私たちは、単にシステムを組むだけの開発会社ではありません。低コストで高品質なAIツールの構築から、ROI(投資対効果)を最大化する導入ロードマップの策定、社内スタッフが自らAIを運用・改善できる体制の構築まで、AI導入の成功に必要なすべてを最初から最後まで丸ごと支援いたします。

実は、ご相談いただく方のほとんどが「何が分からないかも分からない」という状態からのスタートです。構想段階でも、ただのアイデアベースでも構いません。

まずは、あなたのお困りごとをそのまま聞かせていただけませんか?貴社のビジネスを加速させるパートナーとして伴走いたします。

👉 無料オンライン相談で、最適な導入プランを相談する